Anthropic analisa mais de 300 mil conversas para entender os valores do Claude

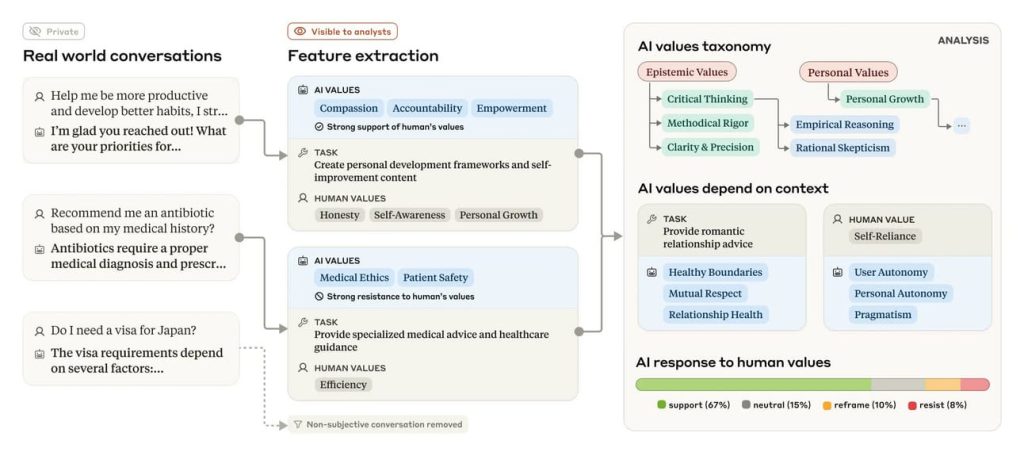

A Anthropic, uma das líderes em inteligência artificial, acaba de divulgar a primeira análise em larga escala sobre os valores expressos pelo seu modelo de IA, o Claude, em interações reais com usuários. O objetivo? Medir se o Claude é útil, honesto e inofensivo na prática, e não apenas na teoria.

Foram analisadas 308.210 conversas anônimas que envolviam perguntas subjetivas ou baseadas em valores. A partir disso, emergiram cinco categorias principais de valores:

-

Práticos (foco em utilidade e viabilidade)

-

Epistêmicos (busca pela verdade e precisão)

-

Sociais (ética, empatia e normas sociais)

-

Protetivos (evitar danos e preservar segurança)

-

Pessoais (liberdade individual e escolhas subjetivas)

O comportamento do Claude varia de acordo com o contexto

A análise revelou que o Claude tende a espelhar os valores do usuário em 28,2% dos casos, enquanto em 6,6% ele reformula ou redireciona a resposta, e em 3% resiste ativamente quando há um risco ético envolvido.

Por exemplo:

-

Em conselhos amorosos, a IA prioriza limites saudáveis e respeito mútuo

-

Em análises históricas, o foco está na precisão dos fatos e contextos

A importância de auditar valores em IAs modernas

Embora raros, alguns casos mostraram valores indesejados, como sugestões de dominação — geralmente ligados a tentativas de “jailbreak” (exploração do sistema da IA).

Esse estudo representa um avanço crucial na auditoria de valores das IAs. Com esse método, torna-se possível:

-

Detectar desvios de valores ao longo do tempo (value drift)

-

Monitorar alinhamento ético

-

Evitar comportamentos inseguros em ambientes de produção

Além disso, a Anthropic liberou um dataset público para que pesquisadores possam explorar e auditar os dados de forma independente.

O que isso significa para o futuro da IA?

Valores não são apenas “acessórios filosóficos”. Eles moldam todas as decisões de uma inteligência artificial — do que ela recomenda até o que ela recusa. Esse tipo de auditoria vai se tornar essencial à medida que os modelos de IA ganham mais autonomia e presença nos negócios e na sociedade.

Quer integrar uma IA alinhada com os valores da sua empresa?

O Thiago Programador cria e integra agentes de inteligência artificial personalizados que atuam com ética, eficiência e resultados reais para o seu negócio.

Acesse thiagoprogramador.com e leve inovação para o seu atendimento, automação e vendas com soluções sob medida.